Quelles limites Sam Altman pose-t-il à l’utilisation des logiciels d’OpenAI par l’armée américaine ? Le 28 février, le fondateur de la start-up a annoncé avoir trouvé avec le Pentagone un accord excluant l’usage de ses outils d’intelligence artificielle (IA) pour les « armes autonomes » ou la « surveillance de masse ».

Ces deux points sont justement les lignes rouges qui ont été fixées par son rival Dario Amodei, d’Anthropic, et qui ont occasionné un conflit très médiatisé avec le Pentagone ayant mené à l’interdiction du recours à ses IA par les militaires américains. Pourtant, le dirigeant de ce concurrent d’OpenAI a estimé que Sam Altman était moins soucieux d’éthique que lui : c’est de « la sécurité de façade », de la part d’un patron ayant « flatté [le président Donald] Trump comme un dictateur », a taclé dans un mémo interne Dario Amodei, jugeant trop flous les termes du contrat obtenu par OpenAI. Sam Altman a, lui, précisé certaines clauses le 3 mars, tout en reconnaissant sur X s’être « trop précipité » dans l’annonce de son deal avec l’armée.

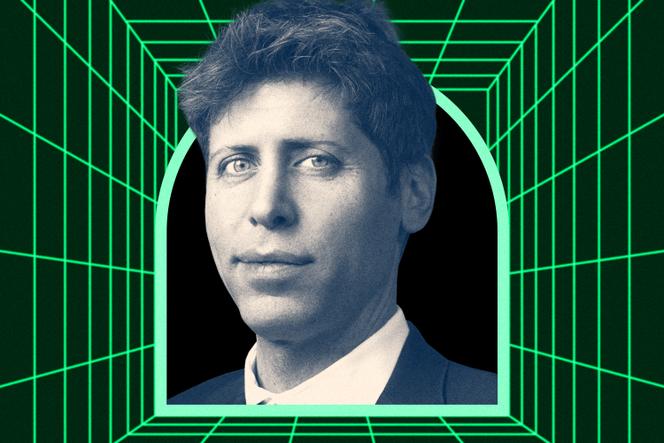

Au-delà de ce clash public entre rivaux, les discours de Sam Altman et de Dario Amodei sur l’IA ont des similitudes et des origines communes, même si les postures du patron d’OpenAI ont évolué. Sam Altman se pose en apôtre de la « superintelligence », capable selon lui de surpasser à terme celle des humains dans la plupart des tâches, voire de « faire un meilleur travail qu’un PDG ou des meilleures recherches que les plus grands scientifiques », a-t-il déclaré mi-février au Sommet pour l’action sur l’IA en Inde.

Il vous reste 75.08% de cet article à lire. La suite est réservée aux abonnés.